- Details

- Written by: Mike Lee

- Category: Cybersecurity

- Hits: 8

En el mundo de la ciberseguridad moderna, la gestión de vulnerabilidades no depende de una sola fuente, sino de un ecosistema coordinado de organizaciones que trabajan juntas para identificar, analizar y priorizar riesgos. Tres pilares fundamentales de este ecosistema son el CVE Program de MITRE, la National Vulnerability Database de NIST y el catálogo KEV de CISA.

CVE: el lenguaje común de las vulnerabilidades

El programa CVE (Common Vulnerabilities and Exposures), gestionado por MITRE, proporciona un identificador único para cada vulnerabilidad conocida. Este identificador (por ejemplo, CVE-2026-XXXX) permite que toda la industria hable el mismo idioma. Sin CVE, sería prácticamente imposible correlacionar información entre fabricantes, analistas y herramientas de seguridad.

Es importante entender que CVE no profundiza en el análisis técnico. Su función es identificar y describir de forma básica la vulnerabilidad, además de enlazar referencias relevantes.

NVD: contexto, severidad y análisis

Una vez que una vulnerabilidad tiene asignado un CVE, entra en juego la NVD (National Vulnerability Database), gestionada por NIST. Aquí es donde la información se enriquece:

Puntuación CVSS (qué tan grave es)

Productos afectados (CPE)

Clasificación de debilidades (CWE)

Detalles técnicos adicionales

La NVD transforma un identificador en información accionable. Permite a los equipos de seguridad entender el impacto potencial y priorizar esfuerzos de remediación.

KEV: la realidad del campo de batalla

El catálogo KEV (Known Exploited Vulnerabilities) de CISA representa un cambio crítico de enfoque: no se trata solo de qué tan grave es una vulnerabilidad, sino de si está siendo explotada activamente.

Una vulnerabilidad puede tener una puntuación CVSS alta en la NVD, pero si no aparece en KEV, podría no ser una prioridad inmediata. Por el contrario, una vulnerabilidad en KEV implica riesgo real y urgente.

Caso práctico: vulnerabilidad en Cisco SD-WAN

Recientemente, Cisco Systems publicó una alerta crítica relacionada con su plataforma SD-WAN. Entre las vulnerabilidades destacaba un bypass de autenticación que permitía a un atacante remoto, sin credenciales, obtener privilegios administrativos.

Veamos cómo este caso recorre el ecosistema:

Descubrimiento: Una organización de seguridad identifica la vulnerabilidad.

Coordinación con el fabricante: Cisco valida el hallazgo y prepara una solución.

Asignación CVE: Se asigna un identificador único a la vulnerabilidad.

Publicación: Cisco emite un advisory con detalles técnicos.

Enriquecimiento: La NVD agrega puntuación CVSS y contexto.

Explotación activa (si aplica): Si se detecta uso en ataques reales, CISA puede incluirla en KEV.

Este tipo de vulnerabilidad —remota, sin autenticación y con alto nivel de privilegios— representa lo que podríamos llamar un “huracán categoría 5” en ciberseguridad.

De la teoría a la acción

Comprender este ecosistema permite a los profesionales pasar de la teoría a la toma de decisiones efectiva:

CVE responde a: ¿Qué vulnerabilidad existe?

NVD responde a: ¿Qué tan grave es?

KEV responde a: ¿Está siendo explotada ahora?

La verdadera madurez en ciberseguridad no está en conocer herramientas, sino en saber priorizar correctamente en función del contexto y la amenaza real.

Conclusión

MITRE, NIST y CISA no operan de forma aislada, sino como un sistema interconectado que define cómo el mundo identifica, evalúa y responde a vulnerabilidades. Dominar este ecosistema no solo es clave para certificaciones como CySA+, sino para desempeñarse eficazmente en entornos reales.

En un panorama donde nuevas vulnerabilidades aparecen constantemente, la diferencia no la marca quién sabe más, sino quién sabe qué es lo más importante en el momento adecuado.

- Details

- Written by: Mike Lee

- Category: Cybersecurity

- Hits: 13

Aprende a olfatear amenazas leyendo patrones

En ciberseguridad, la complejidad suele ocultar lo esencial: el comportamiento.

Muchas cosas en ciberseguridad se visten de complejidad, quizás debido al exceso de números. Stephen Hawking señalaba que cada ecuación adicional reducía el número de lectores. En nuestro caso, el reto es distinto: aprender a distinguir lo normal de lo anómalo.

Una transferencia de datos grande en la madrugada, patrones repetitivos de transmisión o una IP en una ubicación geográfica inusual deberían llamar nuestra atención.

Muchas veces no es necesario analizar cada paquete para detectar una amenaza. El análisis efectivo comienza observando comportamientos.

Aquí es donde entra NetFlow.

Breve historia de NetFlow

NetFlow fue desarrollado en los años 90 por Cisco Systems como una forma de optimizar el enrutamiento y comprender cómo fluía el tráfico dentro de sus dispositivos.

Con el tiempo, su utilidad trascendió el rendimiento de red y se convirtió en una herramienta clave para el monitoreo de tráfico, la detección de anomalías y el análisis de seguridad.

Hoy en día, ha inspirado estándares abiertos como IPFIX, ampliamente utilizados en entornos multi-vendor.

¿Qué es NetFlow?

NetFlow registra quién se comunica con quién, durante cuánto tiempo y cuánto dato se transfiere.

No muestra contenido. Muestra patrones.

La tecnología NetFlow proporciona la base para la medición del tráfico de red, la planificación y el monitoreo de servicios.

Relación con Wireshark y netstat

Desde una perspectiva operativa:

- NetFlow permite detectar anomalías a nivel de red

- Wireshark facilita el análisis detallado del tráfico

- netstat permite validar conexiones activas en el host

En conjunto, estas herramientas permiten pasar de la detección a la verificación.

¿Qué es netstat?

El comando netstat muestra conexiones activas, puertos abiertos, direcciones remotas y el estado de las conexiones en un sistema.

TCP 192.168.1.10:51532 45.33.32.156:443 ESTABLISHEDEsto indica que el equipo tiene una conexión activa con un destino específico en ese momento.

Comparación operativa

| Aspecto | NetFlow | netstat |

|---|---|---|

| Alcance | Red completa | Un solo equipo |

| Tiempo | Histórico + agregado | Tiempo real |

| Nivel | Flujo (resumen) | Conexión individual |

| Ubicación | Router / switch | Endpoint |

| Uso | Detección | Verificación |

Reconocimiento de patrones

A continuación, se presentan ejemplos simplificados con fines didácticos para el reconocimiento de comportamientos anómalos.

Ejemplo 1 — Tráfico normal

Src IP: 192.168.1.10

Dst IP: 45.33.32.156

Dst Port: 443

Protocol: TCP

Bytes: 85000

Duration: 89 secondsPuerto 443, duración y volumen consistentes con navegación web. Probablemente tráfico legítimo.

Ejemplo 2 — Beaconing (C2)

Src IP: 192.168.1.25

Dst IP: 185.199.110.153

Dst Port: 8080

Protocol: TCP

Bytes: 1200

Duration: 4 secondsSi este patrón se repite a intervalos regulares (por ejemplo, cada 60 segundos), puede indicar comunicación con un servidor de comando y control.

Ejemplo 3 — Posible exfiltración

Src IP: 192.168.1.50

Dst IP: 103.21.244.12

Dst Port: 22

Protocol: TCP

Bytes: 95000000

Duration: 900 secondsTransferencia significativa de datos en un puerto administrativo, posiblemente en horario inusual. Debe validarse si corresponde a una operación legítima o a una exfiltración.

Misma información en formato tabular

| Src IP | Dst IP | Port | Proto | Bytes | Duration |

|---|---|---|---|---|---|

| 192.168.1.10 | 45.33.32.156 | 443 | TCP | 85 KB | 89s |

| 192.168.1.25 | 185.199.110.153 | 8080 | TCP | 1.2 KB | 4s |

| 192.168.1.50 | 103.21.244.12 | 22 | TCP | 95 MB | 15m |

Conclusión

NetFlow no muestra la historia completa, pero proporciona suficiente contexto para formular las preguntas correctas.

En ciberseguridad, identificar el patrón adecuado es el primer paso para iniciar una investigación efectiva.

- Details

- Written by: Mike Lee

- Category: Cybersecurity

- Hits: 55

Tomar la decisión de instalar un antivirus o un firewall en una red o equipo pequeña no conlleva mucho debate. Los sistemas operativos actuales suelen traerlos por defecto y de forma gratuita. Sin embargo, volviendo a la triada CIA, hay varios puntos que están flojos. No nos ofrecen disponibilidad, ¿qué pasa si se roban la computadora? ¿si en una inundación se pierde el equipo? Un firewall y un antivirus son controles necesarios pero insuficientes en entornos de información valiosa.

¿Qué pasaría si un psicólogo perdiera los archivos de todos sus clientes?, ¿Si un contador perdiera las declaraciones contables?, o peor aún si se la robaran, ¿Cuánto valen los planos de una vida de un arquitecto o las fotografías de un fotógrafo profesional? O bien se da un acceso no autorizado por parte de un competidor.

Los escenarios podrían ser devastadores, y podrían destruir relaciones comerciales sólidas y hasta una carrera profesional.

Antes de continuar en el análisis de riesgo definamos los puntos centrales. Sobre los conceptos de vulnerabilidad (vulnerability), peligro (threat) y riesgo (risk).

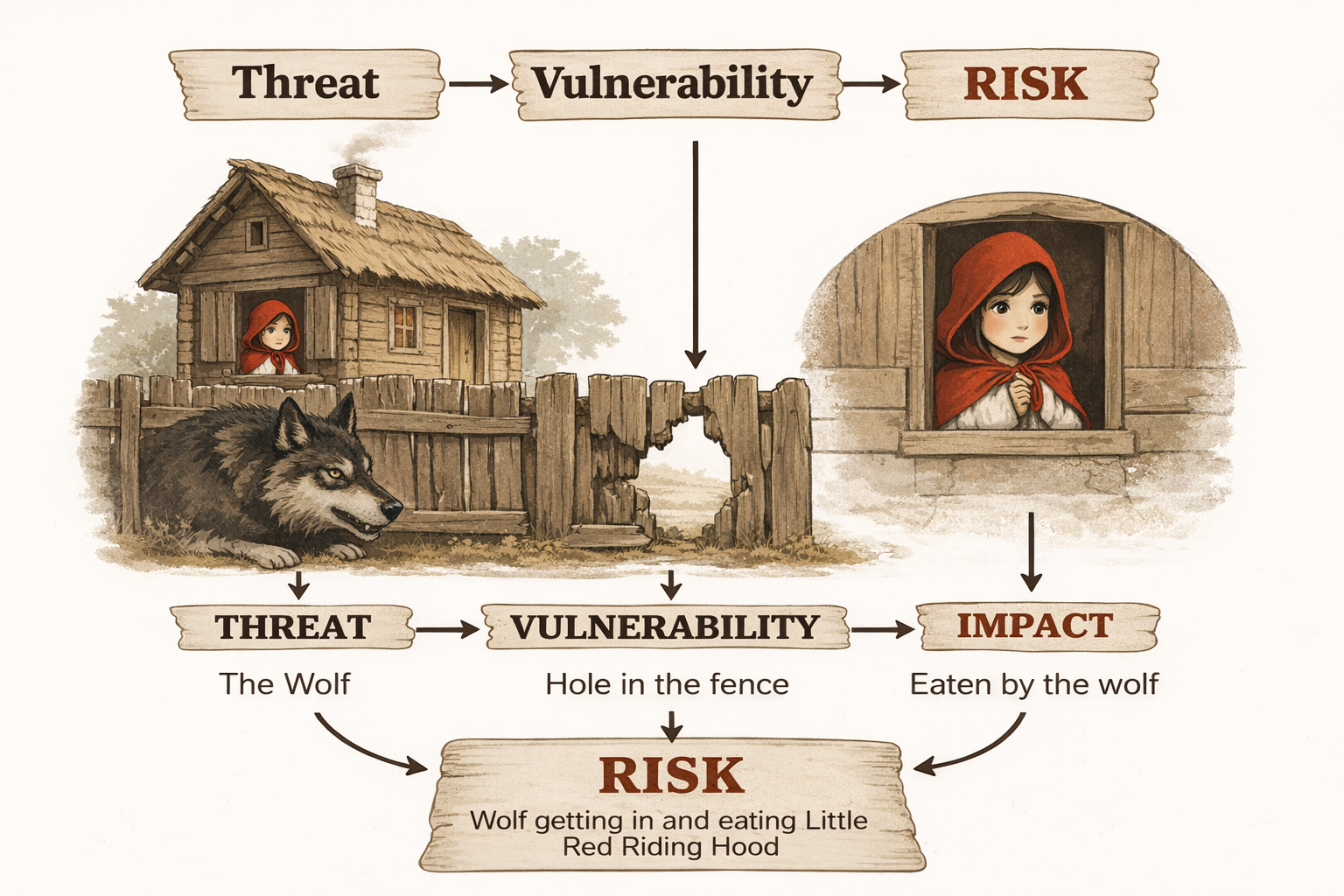

Caperucita y el lobo feroz.

Primero, alineemos conceptos con precisión técnica:

• Threat (amenaza) → El lobo.

• Vulnerability (vulnerabilidad) → El hueco en la cerca.

• Risk (riesgo) → El producto de la amenaza, la vulnerabilidad y el impacto. Es decir, la probabilidad e impacto de que el lobo entre por el hueco y se coma a Caperucita.

• Impact (impacto) → Que se la coma. Caperucita chau.

• Control → La cerca (aunque está mal implementada).

• Attack Vector: el mecanismo con que el lobo

Ahora lo importante:

Que el lobo se la coma no es el riesgo, es el impacto o la materialización del riesgo.

En términos formales:

Risk = Threat × Vulnerability × Impact

Aplicándolo al scenario:

1. 🐺 Hay un lobo (threat).

2. 🪵 Existe un hueco en la cerca (vulnerability).

3. 👧 Caperucita está dentro (asset).

4. Si el lobo entra y la ataca, hay daño (impact).

El risk es la combinación de:

• Que el lobo esté ahí

• Que exista el hueco

• Y que el daño potencial sea alto, en este caso la desafortunada muerte de caperucita.

Si tapamos el hueco:

• La amenaza sigue existiendo (el lobo no desaparece).

• Pero el riesgo baja drásticamente.

Si el lobo no está:

• Hay vulnerabilidad, pero no hay amenaza activa.

• Entonces el riesgo es bajo o latente.

Si Caperucita sabe Kung-Fu:

• El impacto es bajo.

• El riesgo también baja.

Eso es exactamente lo que NIST enseña cuando habla de evaluación de riesgo: no basta con tener una vulnerabilidad; debe existir una amenaza capaz de explotarla.

En la vida real:

Una vulnerabilidad es una debilidad en un dispositivo, sistema, aplñicación o proceso que podría facilitar o permitir un ataque. Software desactualizado, una falla en un servidor web que permite que se realice un DoS attack

Una amenaza o peligro: una fuerza que podría explogar una vulnerabilidad. Por ejemplo un hacker que conoce una vulnerabilidad en un servidor que corre Apache., Un terremoto también podría representar una amenaza o peligro, ya que podría destruir sistemas y equipos electrónicos.

El riesgo: es la combinación de una amenaza, una vulnerabilidad y el impacto. Si un centro de datos por ejemplo, es vulnerable a terremotos, pero se encuentra en una zona de un bajísima posibilidad de sismos , entonces no hay riesgo.

- Details

- Written by: Mike Lee

- Category: Cybersecurity

- Hits: 121

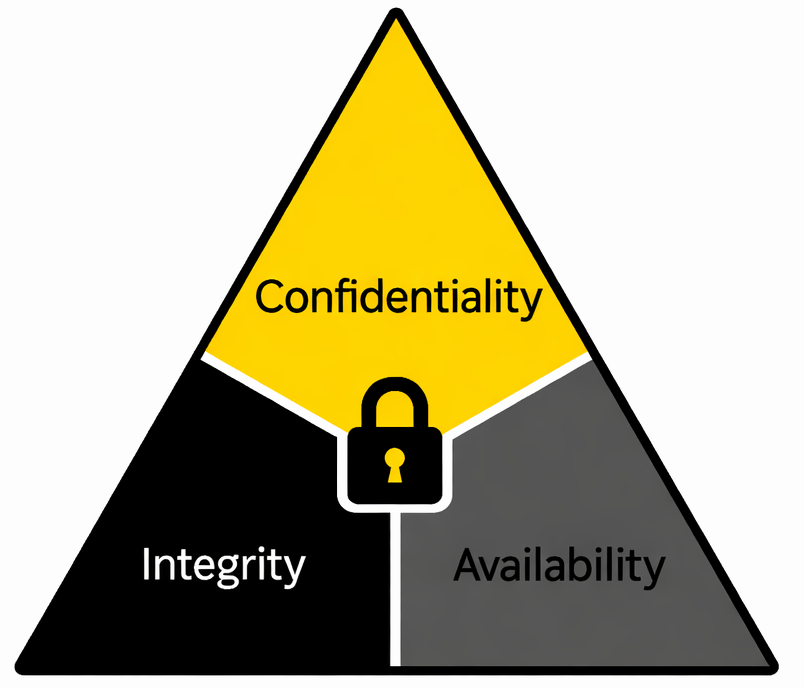

La tríada CIA es uno de los modelos fundamentales de la ciberseguridad. Está compuesta por tres pilares: Confidentiality, Integrity y Availability, de donde provienen las siglas CIA — un mnemónico fácil de recordar por su coincidencia con la Agencia Central de Inteligencia de los Estados Unidos.

En español hablamos de Confidencialidad, Integridad y Disponibilidad (CID).

Este modelo no es simplemente teórico: es la base sobre la cual se diseñan controles, arquitecturas y políticas de seguridad.

Confidencialidad

La confidencialidad asegura que individuos no autorizados no puedan acceder a sistemas o información sensible.

Aquí entran controles como:

-

Firewalls

-

Listas de control de acceso (ACL)

-

Autenticación multifactor (MFA)

-

Encriptación de datos en tránsito y en reposo

El objetivo es simple: solo quienes deben ver la información, la ven.

Integridad

La integridad garantiza que la información y los sistemas no sean modificados de manera no autorizada.

Imaginemos el caos si un atacante pudiera alterar los saldos de cuentas bancarias o manipular registros médicos.

Los controles asociados incluyen:

-

Hashing

-

Firmas digitales

-

Control de versiones

-

Logs inmutables

-

Validaciones de transacciones

Pero hay algo importante: la pérdida de integridad no siempre es causada por atacantes.

Un corte eléctrico en medio de una transacción puede corromper información.

Un fallo de hardware puede alterar datos.

La ciberseguridad no solo combate criminales; también gestiona riesgos operativos y naturales.

Disponibilidad

La disponibilidad busca que la información y los sistemas estén accesibles cuando se necesitan.

No sirve de nada que los datos sean confidenciales e íntegros si el sistema no está disponible.

Aquí hablamos de:

-

Backups

-

Tolerancia a fallos

-

Clustering

-

Redundancia

-

Planes de continuidad del negocio (BCP)

-

Recuperación ante desastres (DRP)

La disponibilidad protege frente a ataques (como DDoS), errores humanos y desastres naturales como incendios o inundaciones.

¿Y quién inventó todo esto?

El origen de la tríada CIA se dio en un contexto histórico muy emocionante. Su origen se remonta a los primeros desarrollos formales de la seguridad informática en los años setenta, cuando el Departamento de Defensa de los Estados Unidos financiaba investigaciones para proteger sistemas interconectados como ARPANET, precursor de Internet. En ese momento se comprendió que la información digital tenía un enorme valor estratégico y que debía protegerse bajo principios rigurosos. Como todo gran avance humano, la interconexión digital no serviría únicamente para el bien.

En 1973, David Elliott Bell y Leonard J. LaPadula desarrollaron el modelo Bell–LaPadula, centrado en la protección de la confidencialidad en sistemas clasificados (Bell & LaPadula, 1973). Este modelo introdujo reglas formales para prevenir el acceso indebido a información sensible y sentó las bases matemáticas para el primer pilar de la seguridad moderna: la confidencialidad.

Posteriormente, Kenneth J. Biba propuso en 1977 un modelo enfocado en la integridad de la información, abordando las limitaciones del enfoque exclusivamente orientado a confidencialidad (Biba, 1977). Su trabajo estableció principios formales para evitar modificaciones no autorizadas o corrupción de datos.

La disponibilidad, aunque no surgió de un modelo matemático específico como los anteriores, se consolidó como pilar esencial con la expansión de sistemas financieros, telecomunicaciones y entornos empresariales críticos en las décadas siguientes. Organismos como el National Institute of Standards and Technology (NIST) y la International Organization for Standardization (ISO) formalizaron la tríada Confidencialidad, Integridad y Disponibilidad como base conceptual en marcos y estándares de seguridad (NIST, 2013; ISO/IEC, 2013).

Así, la tríada CIA no fue creada por una sola persona, sino que emergió como síntesis conceptual de necesidades militares, técnicas y operativas. Desde entonces, constituye el fundamento teórico sobre el cual se diseñan arquitecturas y políticas de ciberseguridad en todo el mundo.

Referencias

Bell, D. E., & LaPadula, L. J. (1973). Secure computer systems: Mathematical foundations and model (MTR-2547). MITRE Corporation.

Biba, K. J. (1977). Integrity considerations for secure computer systems (ESD-TR-76-372). U.S. Air Force Electronic Systems Division.

Chapple, M. & Seidl, David (2023). Cysa+ Study Guide. Third Edition. SYBEX.

National Institute of Standards and Technology (NIST). (2013). Security and Privacy Controls for Federal Information Systems and Organizations (SP 800-53 Rev. 4).

International Organization for Standardization. (2013). ISO/IEC 27001:2013 Information security management systems — Requirements.

,